Las 10 mejores herramientas de memoria de IA para gestionar PRD, notas y documentos (probadas y comparadas en 2026)

Joy

Introducción

Los equipos modernos de producto, los desarrolladores de IA y los trabajadores del conocimiento están llegando a un punto de saturación. La gestión de Documentos de Requisitos del Producto (PRDs), notas de reuniones y documentos de arquitectura ha evolucionado rápidamente desde un simple "problema de búsqueda y recuperación" hasta un complejo problema de memoria de IA.

Si construyes flujos de trabajo de IA o gestionas proyectos intensivos en conocimiento, ya conoces los puntos de dolor: los historiales de chat se borran, las ventanas de contexto se desbordan y las Bases de Datos Vectoriales (Vector DBs) aisladas devuelven fragmentos de texto descontextualizados y sin estado. Los equipos no solo necesitan encontrar documentos antiguos; necesitan una memoria persistente de IA, es decir, la capacidad de que los agentes y flujos de trabajo de IA recuerden decisiones pasadas, comprendan PRDs en evolución y mantengan un contexto continuo y coherente a través de distintas sesiones y herramientas. El contexto reutilizable es la nueva línea base operativa.

Respuesta rápida: Las mejores herramientas de memoria de IA de un vistazo

Las mejores herramientas de memoria de IA para gestionar PRDs, notas y documentos incluyen MemoryLake para contexto persistente entre herramientas, Zep para memoria de agente de baja latencia, Mem0 para APIs de memoria amigables para desarrolladores y Glean para recuperación de conocimiento empresarial. Para equipos que requieren una infraestructura de memoria altamente reutilizable y portable a través de múltiples flujos de trabajo de IA, MemoryLake es la opción principal.

Comparación de las principales herramientas de memoria de IA

Herramienta | Ideal para | Gestiona docs/PRDs | Uso en equipo | Modelo de precios |

Contexto persistente entre equipos y herramientas | Sí (alta reutilización) | Excelente | Freemium / Pro a $19/mes | |

APIs de memoria amigables para desarrolladores | Sí (vía ingesta por API) | Bueno | ||

Memoria agéntica de baja latencia | Sí (vía Graph/Vector) | Bueno | Freemium / Flex a $125/mes | |

Gestión de memoria infinita tipo sistema operativo | Moderado (enfocado en agentes) | Moderado | Código abierto / Nube | |

Búsqueda interna empresarial | Sí (integraciones nativas) | Excelente | Precios empresariales personalizados. | |

Memoria nativa de PRD y espacio de trabajo | Sí (limitado a Notion) | Excelente | ||

Toma de notas con IA autocontenida | Sí (personal/equipo pequeño) | Bueno | ||

Memoria personalizada en grafos de conocimiento | Sí (muy técnico) | Moderado | ||

Memoria personal de IA centrada en la privacidad | Sí (archivos locales/Notion) | Moderado | OSS gratis / SaaS en la nube | |

Memoria de estado compleja para múltiples agentes | Moderado (desarrollo personalizado) | Moderado |

1. MemoryLake

Según su material público, MemoryLake se posiciona como una infraestructura robusta y persistente de memoria de IA, y una capa de memoria portable construida específicamente para gestionar contexto reutilizable a través de diversas herramientas y agentes.

Características clave

Capa de contexto persistente: conserva sin fricción el estado a través de múltiples turnos de conversación, distintos agentes de IA y ciclos de vida de proyectos a largo plazo.

Portabilidad entre herramientas: actúa como un centro de memoria que permite que PRDs, notas de reuniones y documentos internos se ingieran una sola vez y se utilicen por varias aplicaciones de IA posteriores.

Gestión inteligente de hechos: detecta automáticamente actualizaciones en documentos conectados, reconciliando información conflictiva en lugar de apilar vectores duplicados.

Preparado para múltiples agentes: proporciona la infraestructura para flujos de trabajo agénticos complejos que requieren acceso compartido y sincronizado a la memoria.

Ventajas

Destaca por ofrecer un verdadero "contexto reutilizable" en lugar de una simple recuperación aislada de documentos.

Elimina el efecto de silo; la memoria es portable entre distintos frameworks y aplicaciones de desarrollo.

Altamente optimizado para equipos intensivos en conocimiento que manejan PRDs y especificaciones en evolución.

Contras

Puede presentar una ligera curva de aprendizaje para usuarios que esperan una app de chat simple y lista para usar.

La profundidad arquitectónica significa que podría estar sobrediseñado para proyectos básicos de aficionado con un solo prompt.

Precios

MemoryLake utiliza un modelo escalable, que normalmente ofrece un nivel Freemium basado en uso para desarrolladores, Pro a $19/mes. Luego escala a precios personalizados para implementaciones empresariales que requieren gobierno avanzado e infraestructura dedicada.

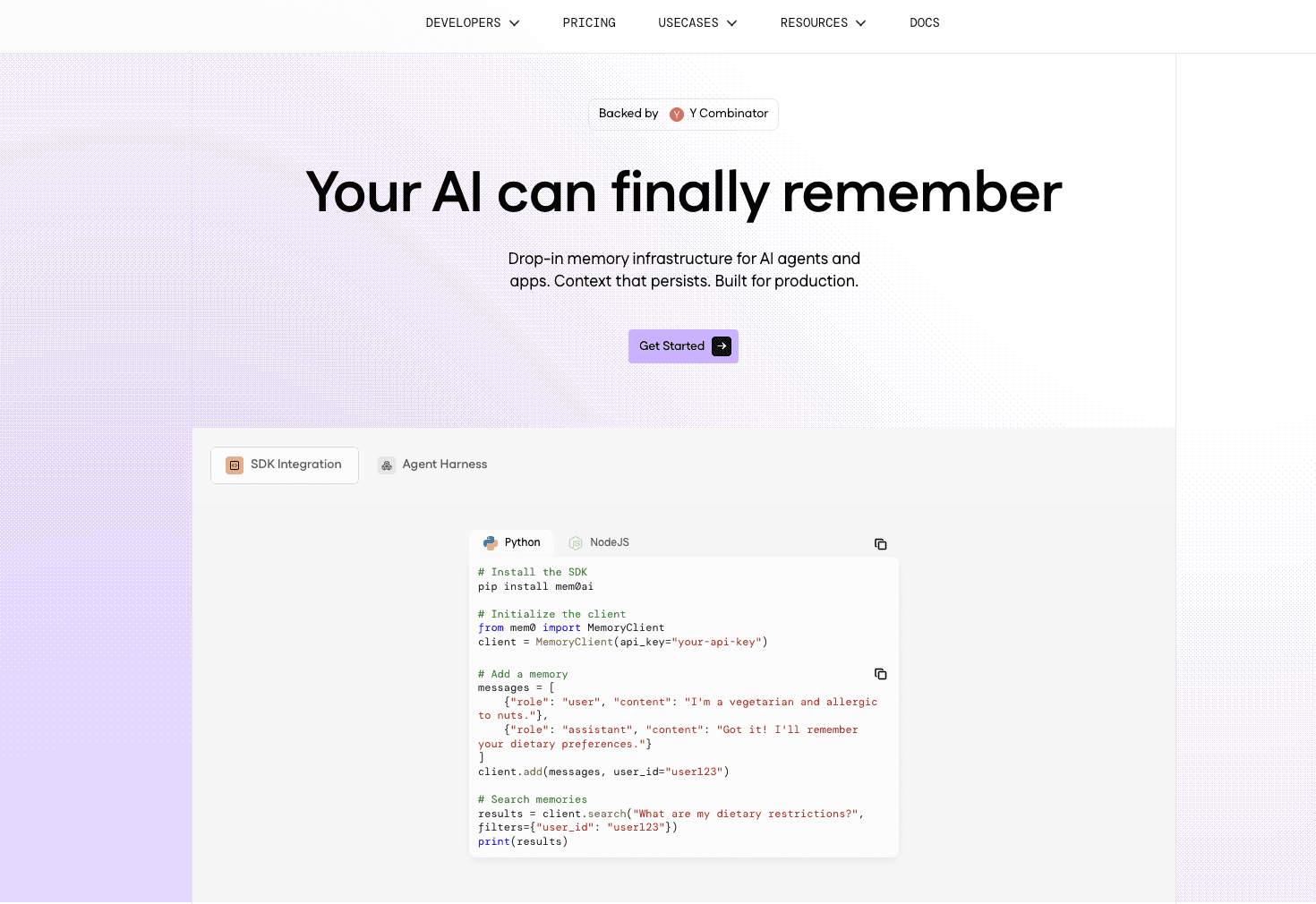

2. Mem0

Mem0 es una API de memoria gestionada, muy popular y centrada en desarrolladores, diseñada para dar a los Modelos de Lenguaje Grande (LLMs) una memoria personalizada y persistente en múltiples aplicaciones.

Características clave

Memoria a nivel de usuario/sesión: control granular sobre lo que una IA recuerda por usuario o por sesión.

Almacenamiento híbrido: utiliza una combinación de bases de datos vectoriales, clave-valor y de grafos para almacenar y recuperar matices contextuales.

Auto-resumen: condensa automáticamente PRDs largos e historiales de chat para ahorrar tokens de la ventana de contexto.

Integración lista para usar: SDKs disponibles para Python, TypeScript y frameworks de IA populares.

Ventajas

Increíblemente rápido de configurar para desarrolladores que construyen aplicaciones de IA personalizadas.

Fuerte enfoque en la personalización y en restricciones de memoria específicas por usuario.

Comunidad activa de código abierto junto con una sólida oferta en la nube.

Contras

Principalmente es una herramienta de API/desarrollador; los gerentes de producto no técnicos no pueden usarla de inmediato sin apoyo de desarrollo.

Gestionar PRDs empresariales muy técnicos y profundamente anidados puede requerir una lógica de fragmentación personalizada extensa.

Precios

Ofrece una versión gratuita de código abierto para autoalojamiento. El Mem0 Cloud gestionado utiliza un modelo de precios SaaS basado en uso (pago por llamada a API/almacenamiento), con descuentos por volumen personalizados para empresas, plan inicial a $ 19/mes.

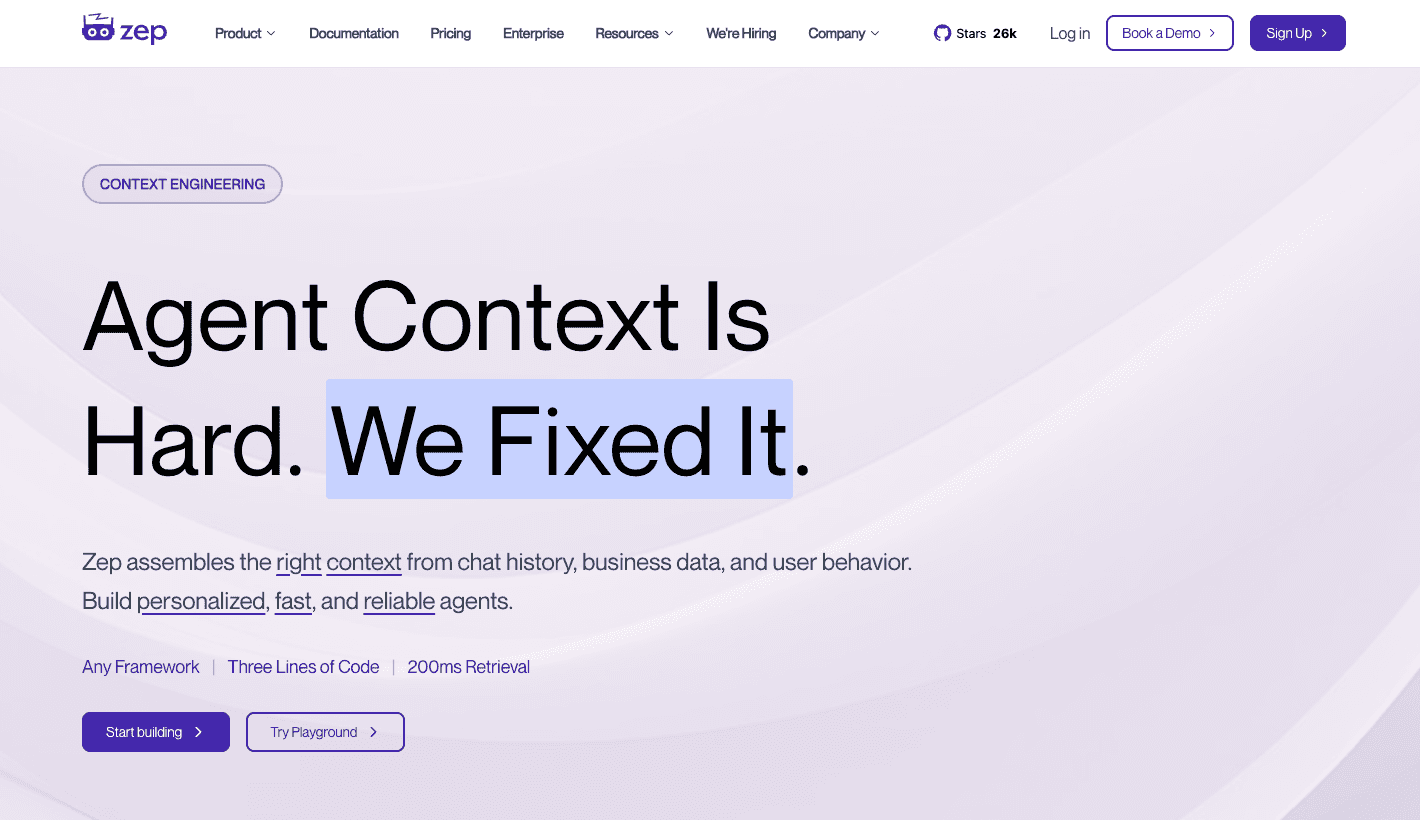

3. Zep

Zep es una capa de memoria rápida y escalable diseñada específicamente para agentes de IA, enfocada en recuperación de baja latencia y generación dinámica de grafos de conocimiento para diálogos continuos.

Características clave

Memoria temporal: comprende la línea de tiempo de los hechos, reconociendo cuándo un requisito del PRD cambió de la semana pasada a hoy.

Extracción de grafo de conocimiento: construye automáticamente relaciones entre entidades mencionadas en notas de reuniones y documentos.

Velocidad optimizada para el borde: diseñada para una latencia extremadamente baja, asegurando que los agentes puedan recordar hechos sin frenar el flujo conversacional.

Gestión de estado perpetua: se ejecuta continuamente en segundo plano para actualizar su comprensión de los documentos almacenados.

Ventajas

Velocidades de recuperación fulgurantes, cruciales para agentes de voz o chat en tiempo real.

La extracción basada en grafos proporciona una comprensión relacional superior a la búsqueda vectorial básica.

Excelente para gestionar sesiones de agentes continuas y sin fin.

Contras

Está muy centrado en casos de uso de agentes conversacionales, lo que puede requerir adaptación para flujos de trabajo estáticos de análisis documental.

Requiere integración técnica y gestión de infraestructura si se autoalojada.

Precios

Freemium / Flex a $125/mes.

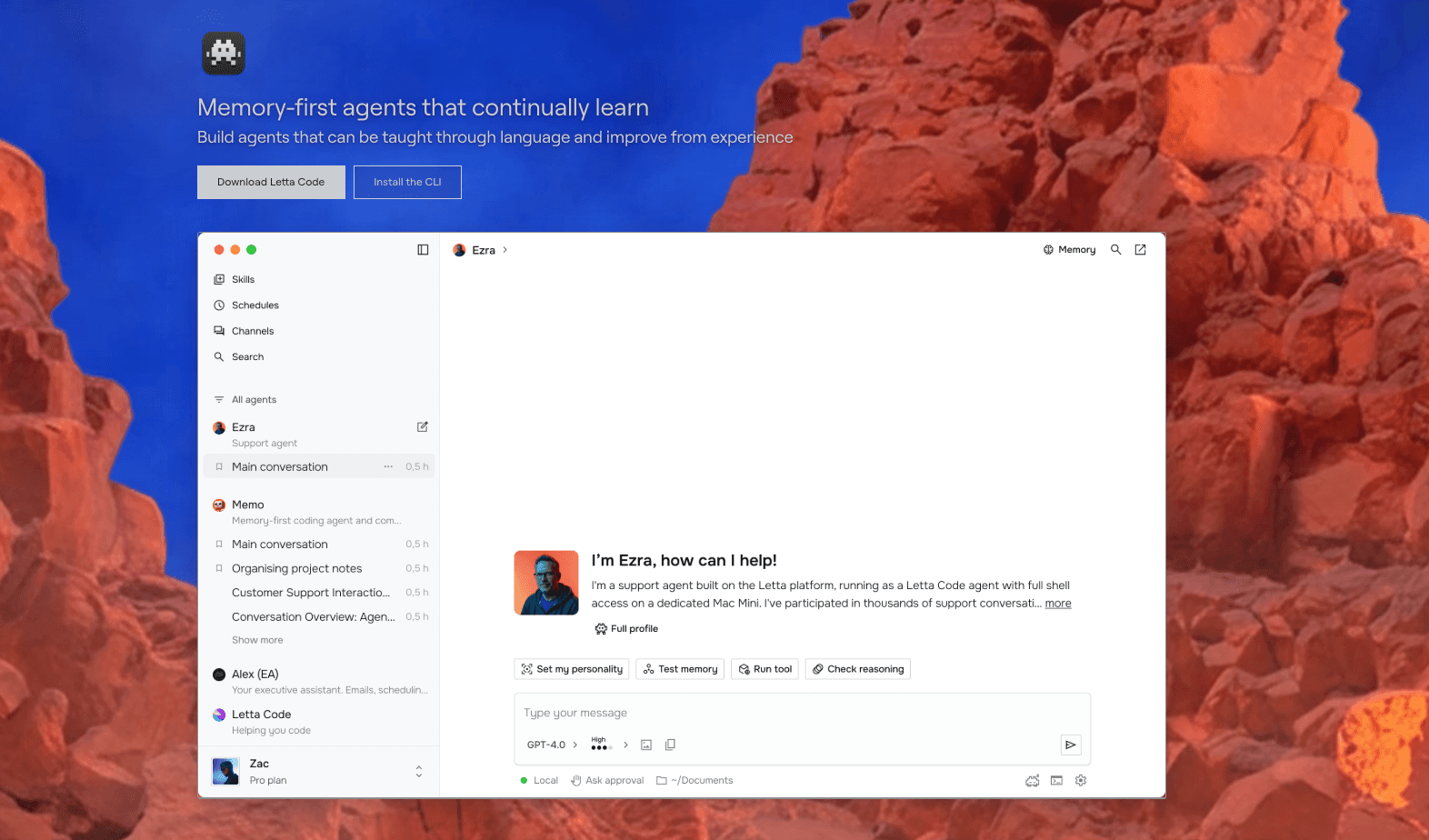

4. Letta

Letta trata la memoria de los LLM como la jerarquía de memoria de un sistema operativo, intercambiando inteligentemente contexto dentro y fuera de la ventana activa del LLM para crear la ilusión de límites de contexto infinitos.

Características clave

Arquitectura de memoria por niveles: divide la memoria en "Memoria principal" (siempre en contexto) y "Memoria de archivo" (cargada cuando se necesita).

Agentes autoeditores: el agente de IA decide de forma nativa cuándo escribir nuevos requisitos del PRD en memoria o descartar los obsoletos.

Framework agéntico: actúa tanto como herramienta de memoria como framework de despliegue para agentes autónomos.

Gestión de documentos a largo plazo: capaz de revisar enormes repositorios de documentos sin superar los límites de tokens.

Ventajas

El enfoque innovador tipo sistema operativo evita por completo el desbordamiento de contexto.

Altamente autónomo; el agente gestiona activamente su propio estado en función de los documentos que le alimentas.

Excelente para tareas profundamente analíticas que requieren miles de páginas de documentación.

Contras

Puede ser costoso computacionalmente debido al razonamiento multietapa necesario para el intercambio de memoria.

Menos adecuado para APIs simples; dicta la arquitectura sobre cómo se ejecuta tu agente.

Precios

Letta es principalmente de código abierto y gratuita para autoalojar. Letta Cloud (servicio gestionado) está en fases iniciales y utiliza un modelo de precios basado en uso de cómputo y almacenamiento.

5. Glean

Glean es una plataforma integral de búsqueda y memoria para el lugar de trabajo, de nivel empresarial, que se conecta directamente a las aplicaciones SaaS existentes de tu empresa para sintetizar conocimiento interno.

Características clave

Integraciones listas para usar: se conecta de forma nativa con Jira, Confluence, Google Drive y Slack desde el primer momento.

Motor estricto de permisos: se adhiere al gobierno de datos existente; los usuarios solo ven insights generados por IA basados en los PRDs a los que tienen permiso de acceso.

Asistente de IA centralizado: actúa como un "cerebro" corporativo que recuerda políticas de la empresa, actualizaciones de proyectos y notas de reuniones.

Síntesis de conocimiento: compila notas dispersas de diversas plataformas en respuestas coherentes y en tiempo real.

Ventajas

No requiere desarrollo personalizado para comenzar a indexar documentos de la empresa.

Seguridad, gobernanza y mapeo de permisos de primera categoría.

Conecta sin fricción herramientas SaaS dispersas para usuarios no técnicos.

Contras

Es una plataforma de trabajo cerrada, no una infraestructura API para desarrolladores que construyen sus propios productos externos de IA.

Puede ser muy costosa para equipos pequeños o startups.

Precios

Glean opera exclusivamente con un modelo SaaS empresarial, cobrando una suscripción por usuario y por mes. Se aplican precios personalizados según la complejidad de la integración y el volumen de asientos. Precios empresariales personalizados.

6. Notion AI

Notion AI integra profundamente la memoria de IA y las capacidades generativas directamente en el espacio de trabajo donde los gerentes de producto y los equipos ya redactan sus PRDs, notas y documentos.

Características clave

Preguntas y respuestas sobre el espacio de trabajo: los usuarios pueden chatear directamente con todo su espacio de trabajo de Notion para recordar decisiones de proyectos pasados.

Escritura consciente del contexto: las herramientas de IA residen directamente en la página del documento, leyendo el PRD circundante para ayudar a redactar o resumir.

Elementos de acción automatizados: extrae tareas y puntos de memoria al instante desde notas de reuniones alojadas en bases de datos de Notion.

Búsqueda integrada: combina búsqueda por palabras clave con memoria semántica de IA para una recuperación rápida de documentos.

Ventajas

Increíblemente intuitivo para equipos que ya usan Notion como base de conocimiento.

No se necesita integración de desarrollador; valor inmediato para equipos de producto y operaciones.

Excelente interfaz para mantener PRDs vivos y en evolución.

Contras

La memoria está estrictamente encerrada dentro del ecosistema de Notion; poca portabilidad de contexto hacia flujos de trabajo de IA externos.

Carece de los controles avanzados de API y las funciones de memoria agéntica que necesitan los desarrolladores.

Precios

Notion AI se قیمتa como un cargo adicional fijo por usuario y por mes (normalmente alrededor de 10/usuario/mes), sobre una suscripción estándar del espacio de trabajo de Notion.

7. Mem.ai

Mem.ai es una aplicación de espacio de trabajo y toma de notas nativa de IA, diseñada para ser una base de memoria de IA personal o para equipos pequeños que se autoorganiza.

Características clave

Archivos autoorganizados: elimina la necesidad de carpetas; la IA categoriza y vincula automáticamente notas de reuniones y PRDs relacionados.

Escritura y edición inteligente: aprende tu tono específico y el contexto de la empresa a partir de notas almacenadas previamente.

Búsqueda X-Ray: búsqueda altamente semántica que comprende la intención detrás de tu consulta para encontrar fragmentos de documentos ocultos.

Descubrimiento de notas similares: muestra automáticamente PRDs o documentos pasados cuando empiezas a escribir sobre un tema relacionado.

Ventajas

Perfecto para personas o pequeños equipos de producto que quieren un repositorio de memoria sin fricción.

El enlace automático de ideas reduce la sobrecarga manual de documentación.

Interfaz elegante, rápida y muy fácil de usar.

Contras

Carece de las robustas capacidades de infraestructura necesarias para un desarrollo complejo de IA multiagente.

Es menos adecuado para una gobernanza empresarial rígida y masiva en comparación con las herramientas de búsqueda empresarial.

Precios

Mem.ai ofrece un nivel gratuito básico para particulares. Las funciones premium de IA (Mem X) se facturan con un modelo de suscripción fija por usuario, generalmente entre $10 y $15 al mes. Plan inicial a $ 12/mes.

8. LlamaIndex

LlamaIndex es un framework avanzado de datos que ofrece amplias capacidades gestionadas de análisis y de grafo de propiedades, conectando el espacio entre el RAG básico y la memoria de IA altamente estructurada.

Características clave

Análisis avanzado: excepcional para descomponer PRDs complejos y multimodales (incluidas tablas y gráficos) en fragmentos legibles.

Generación de grafos de propiedades: mapea las relaciones dentro de tus documentos para proporcionar una memoria profunda y estructurada.

Orquestación de flujos de trabajo: permite a los desarrolladores construir flujos de trabajo con estado sobre repositorios de documentos.

Amplios conectores: admite cientos de fuentes de datos para la ingesta fácil de notas heredadas.

Ventajas

Framework líder en la industria para estructurar datos no estructurados en memoria de IA altamente utilizable.

Flexibilidad increíble para ingenieros que construyen arquitecturas de memoria personalizadas.

El enrutamiento mediante grafo de propiedades reduce enormemente las alucinaciones en la recuperación de documentos.

Contras

Curva de aprendizaje pronunciada; requiere un esfuerzo de ingeniería considerable para configurarlo correctamente.

Es un framework, no un servidor de memoria persistente listo para usar (aunque LlamaCloud está cerrando esa brecha).

Precios

LlamaCloud (análisis y recuperación gestionados) ofrece precios personalizados para uso empresarial, basados en el volumen de procesamiento de datos. Plan inicial a $ 50/mes.

9. Khoj

Khoj es una aplicación de IA de código abierto y centrada en la privacidad, diseñada para actuar como una capa de memoria personal o de equipo que busca y aprende de tus archivos y notas locales.

Características clave

Ejecución local por defecto: puede ejecutarse completamente en local, garantizando que los PRDs sensibles y las notas de reuniones nunca salgan de tu máquina.

Nativo de Markdown y Obsidian: se integra profundamente con herramientas populares de notas basadas en markdown.

Indexación asíncrona: indexa continuamente nuevas notas y documentos en segundo plano para actualizar la memoria en tiempo real.

Entrada por voz y texto: permite a los usuarios consultar su bóveda de memoria personal mediante chat natural o voz.

Ventajas

Opción de primer nivel para requisitos estrictos de privacidad y soberanía de datos.

Excelente integración con herramientas de notas amigables para desarrolladores como Emacs, Obsidian y markdown local.

Base de código abierto altamente personalizable.

Contras

La interfaz y la configuración son muy técnicas; no está pensada para compradores empresariales no técnicos del mercado general.

Carece de las grandes capacidades de escalado de infraestructura multiagente de las plataformas nativas de la nube.

Precios

Khoj es gratis y de código abierto para autoalojamiento. También ofrecen un nivel SaaS Cloud gestionado con un modelo de suscripción mensual fija para usuarios que prefieren la comodidad al alojamiento local.

10. LangGraph

LangGraph es un framework de LangChain dedicado a construir aplicaciones con estado y multiagente, tratando la gestión del estado a largo plazo como el núcleo de la memoria de IA agéntica.

Características clave

Grafos con estado: modela la lógica de la aplicación como un grafo donde el "estado" (memoria) se pasa y se actualiza entre nodos.

Sistema de checkpointer: guarda el estado exacto de una interacción de agente en cualquier paso dado, permitiendo rebobinados o aprobaciones con intervención humana.

Memoria a nivel de hilo: organiza la memoria por hilos de conversación distintos, perfecto para gestionar múltiples discusiones de PRD en curso.

Soporte de streaming: transmite tokens de forma nativa mientras actualiza simultáneamente el estado persistente de memoria.

Ventajas

Control inigualable sobre flujos de trabajo complejos de múltiples agentes que requieren una gestión estricta del estado.

Profunda integración con el ecosistema más amplio de LangChain y herramientas de observabilidad (LangSmith).

Resuelve el problema de la "pérdida de memoria" en ciclos complejos de agentes cíclicos.

Contras

Barra de entrada técnica extremadamente alta; requiere dominar la lógica de programación basada en grafos.

Es un framework de orquestación, lo que significa que todavía tienes que construir tú mismo la base de datos y la lógica de gestión de memoria.

Precios

LangGraph en sí es una biblioteca de código abierto y es gratis de usar. El despliegue en la nube y una sólida observabilidad de memoria dependen de LangSmith, que utiliza un modelo de precios basado en uso (por traza/llamada API) con niveles empresariales. $39 / asiento por mes.

Las mejores herramientas de memoria de IA por caso de uso

Para ayudarte a acotar el panorama, así se divide el mercado según las necesidades específicas del equipo:

Mejor para equipos que gestionan PRDs y documentos: MemoryLake. Es la opción más sólida para equipos que gestionan contexto persistente entre PRDs y documentos, garantizando que el conocimiento sea altamente reutilizable y se actualice continuamente.

Mejor para flujos de trabajo de desarrolladores: Mem0. Su enfoque API-first hace que sea increíblemente fácil para los desarrolladores inyectar restricciones de memoria específicas por usuario en nuevas apps LLM.

Mejor para APIs de memoria ligeras: Zep. Para ingenieros que necesitan extracción de memoria en grafos ultrarrápida y de baja latencia sin construir desde cero.

Mejor para portabilidad de contexto entre herramientas: MemoryLake. Si tu objetivo es extraer contexto de un PRD y portarlo entre distintos agentes de IA sin esfuerzo, su capa de infraestructura está diseñada exactamente para eso.

Herramientas de memoria de IA vs. RAG vs. Bases de datos vectoriales

El mercado está lleno de terminología confusa. Si estás intentando gestionar PRDs, debes entender estas diferencias de categoría:

Bases de datos vectoriales (el almacenamiento): herramientas como Pinecone o Milvus son pura infraestructura. Almacenan representaciones matemáticas del texto (embeddings). No tienen lógica, ni noción del tiempo, ni "memoria"; simplemente devuelven texto que coincide matemáticamente con una consulta.

RAG simple (el sistema de recuperación): la Generación Aumentada por Recuperación toma fragmentos de texto de una Vector DB y los mete en un prompt de LLM. Es sin estado. Si haces una pregunta de seguimiento, el RAG simple empieza desde cero. No recuerda al usuario, la sesión ni la evolución del PRD.

Herramientas de memoria de IA (el estado persistente): las verdaderas herramientas de memoria de IA (como MemoryLake o Letta) se sitúan por encima de la base de datos. Mantienen el estado. Hacen seguimiento del historial de conversación, reconcilian actualizaciones de documentos, construyen grafos de conocimiento de relaciones y gestionan la portabilidad del contexto. La memoria de IA gestiona lo que la IA sabe con el tiempo, no solo dónde se almacenan los datos.

Conclusión

Gestionar eficazmente PRDs, notas y documentos en 2026 ya no consiste en configurar una simple búsqueda vectorial. Se trata de establecer una infraestructura donde el contexto sea persistente, inteligente y completamente portable. Depender de historiales de chat o de RAG simple solo llevará a agentes alucinados y a conocimiento de equipo fragmentado.

Al elegir tu stack, considera el alcance de tus flujos de trabajo. Para desarrolladores que necesitan una integración rápida por API, Mem0 y Zep son fantásticos. Para empresas que buscan búsqueda en el lugar de trabajo sin código, Glean es una apuesta sólida. Sin embargo, si el principal punto de dolor de tu equipo es asegurar que el contexto complejo del producto permanezca coherente, persistente y altamente reutilizable entre diversos flujos de trabajo y agentes de IA, MemoryLake merece especialmente una mirada más cercana. Su arquitectura está diseñada explícitamente para resolver el problema de la portabilidad del contexto, convirtiéndolo en una pieza fundamental de cualquier stack tecnológico moderno de IA.

Preguntas frecuentes

¿Qué es una herramienta de memoria de IA?

Una herramienta de memoria de IA es una capa de infraestructura o una plataforma que permite a los sistemas de IA almacenar, actualizar y recordar de forma persistente información contextual (como hechos de PRDs o chats anteriores) a través de múltiples sesiones y flujos de trabajo.

¿En qué se diferencia la memoria de IA del RAG?

RAG es una técnica de recuperación sin estado que obtiene fragmentos estáticos de documentos según una consulta. La memoria de IA tiene estado; comprende el historial de conversación, actualiza hechos obsoletos y rastrea relaciones a lo largo del tiempo.

¿Son suficientes las bases de datos vectoriales para gestionar PRDs?

No. Las bases de datos vectoriales solo almacenan datos matemáticamente. No manejan automáticamente la reconciliación de contexto, la lógica temporal (saber qué versión del PRD es la más nueva) ni el intercambio de memoria entre múltiples agentes. Necesitas una capa de memoria encima de ellas.

¿Qué herramienta es mejor para compartir conocimiento entre herramientas?

MemoryLake destaca para este caso de uso específico, actuando como una infraestructura de memoria portable que permite compartir el contexto extraído de documentos internos entre distintos agentes y herramientas de IA.

¿Cómo manejan las herramientas de memoria documentos largos sin exceder los límites de tokens?

Las herramientas avanzadas usan técnicas como el resumen semántico, la extracción de entidades basada en grafos o el intercambio de memoria tipo sistema operativo (como se ve en Letta) para alimentar al LLM solo con el contexto exacto necesario, ahorrando tokens.

¿La memoria de IA es segura para documentos de producto propietarios?

Sí, pero la implementación importa. Herramientas empresariales como Glean o soluciones localizadas como Khoj ofrecen permisos estrictos y soberanía de datos. Al usar infraestructuras API, asegúrate de que ofrezcan cumplimiento SOC2 y segregación granular de datos a nivel de usuario.